Los creadores del Photoshop avanzan en una tecnología para detectar imágenes manipuladas

La investigación muestra cómo el aprendizaje automático puede utilizarse para identificar imágenes adulteradas.

Adobe, la empresa creadora del Photoshop, el software de manipulación de imágenes más famoso del mundo, presentó un paper en el que detalla una investigación relacionada con la detección de imágenes adulteradas.

El trabajo, presentado en la conferencia CVPR enfocada a la visión por computadora, demuestra cómo las técnicas forenses digitales hechas por humanos pueden ser automatizadas por las máquinas en mucho menos tiempo.

Según publica The Verge, el trabajo de investigación muestra cómo el aprendizaje automático puede utilizarse para identificar tres tipos comunes de manipulación de imágenes: empalme, donde se combinan dos partes de imágenes diferentes; clonación, donde los objetos dentro de una imagen son copiados y pegados; y eliminación, cuando un objeto se borra por completo.

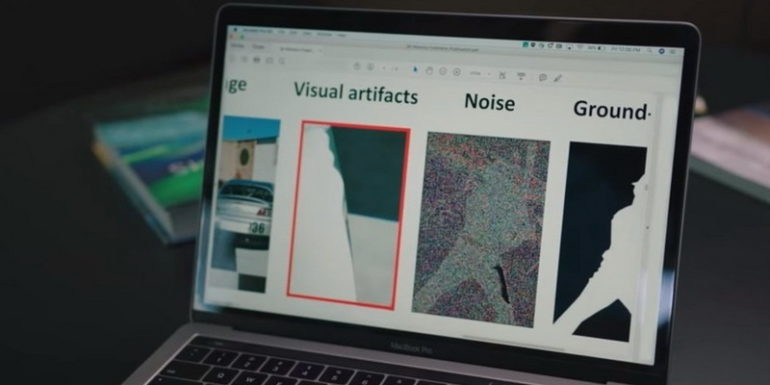

Algunos ejemplos de imágenes alteradas y cómo el sistema las detecta.

Para detectar este tipo de alteración, los forenses digitales generalmente buscan pistas en capas ocultas de la imagen.

Cuando se realizan este tipo de ediciones, se dejan detrás “ruidos” digitales, como inconsistencias en las variaciones aleatorias de color y brillo creadas por los sensores de imagen. Cuando se empalman dos imágenes diferentes, por ejemplo, o se copia y pega un objeto de una parte de una imagen a otra, este ruido de fondo no coincide, como una mancha en una pared cubierta con un color de pintura ligeramente diferente.

Al igual que con muchos otros sistemas de aprendizaje automático, el de Adobe se entrenó con un gran conjunto de imágenes editadas, con el que aprendió a detectar los patrones comunes que indican que hubo algún tipo de adulteración.

Sin embargo, la investigación no tiene una aplicación directa para detectar deepfakes, una nueva generación de videos editados creados con inteligencia artificial.

El trabajo de investigación muestra cómo el aprendizaje automático puede utilizarse para identificar tres tipos comunes de manipulación de imágenes.

Imágenes y fake news

Adobe, en su blog, intenta responder a una pregunta muy en boga por estos días: ¿qué medio podemos tomar como una versión auténtica de la realidad?

Jon Brandt, científico principal y director de Adobe Research, dice que esta cuestión a menudo se reduce a la confianza y la reputación en lugar de a la tecnología. “The Associated Press y otras organizaciones de noticias publican pautas para la edición digital apropiada de fotografías para los medios de comunicación”, explica.

Una imagen editada de un lanzamiento de misiles publicada por el gobierno de Irán en 2008, que llegó a los medios occidentales como verdadera.

“Creo que una de las funciones más importantes que Adobe puede desempeñar es desarrollar tecnología que ayude a los medios a controlar y verificar la autenticidad como parte de ese proceso”, agrega.

“Es importante desarrollar la tecnología de manera responsable, pero en última instancia estas tecnologías se crean al servicio de la sociedad. En consecuencia, todos compartimos el compromiso de abordar los impactos negativos potenciales de las nuevas tecnologías a través de cambios en nuestras instituciones y convenciones sociales “, completa.

Fuente: Clarín